[TOC]

在详细理解了Transformer模型后,再来看下Transormer的改进。

首先收藏一张图,详细介绍Transformer, 以及重述一下理解的博文:

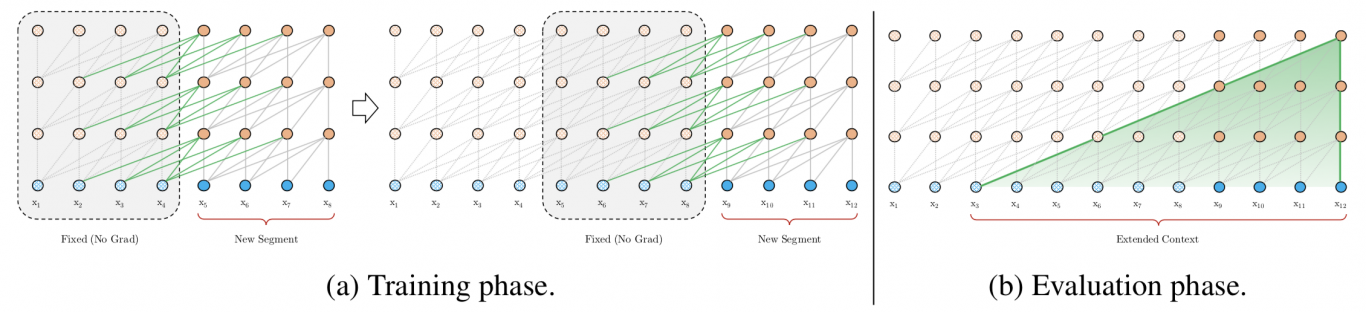

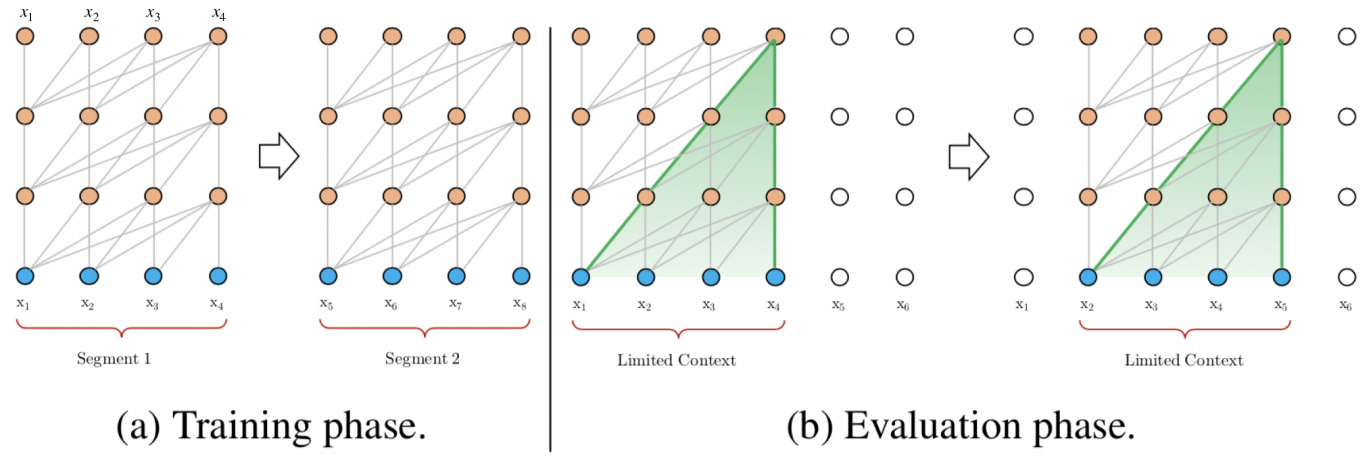

在机器翻译中使用(vanilla) Transformer,是根据前面的字符预测下一个字符,而它只能处理最大521个字符长度。所以做了一个改动:将输入分成多个小段,然后对每个段进行学习。在测试时候,如果段太长,就逐次向后移动一个字符进行预测。

Transformer-XL

Transformer-XL改进点有两个:

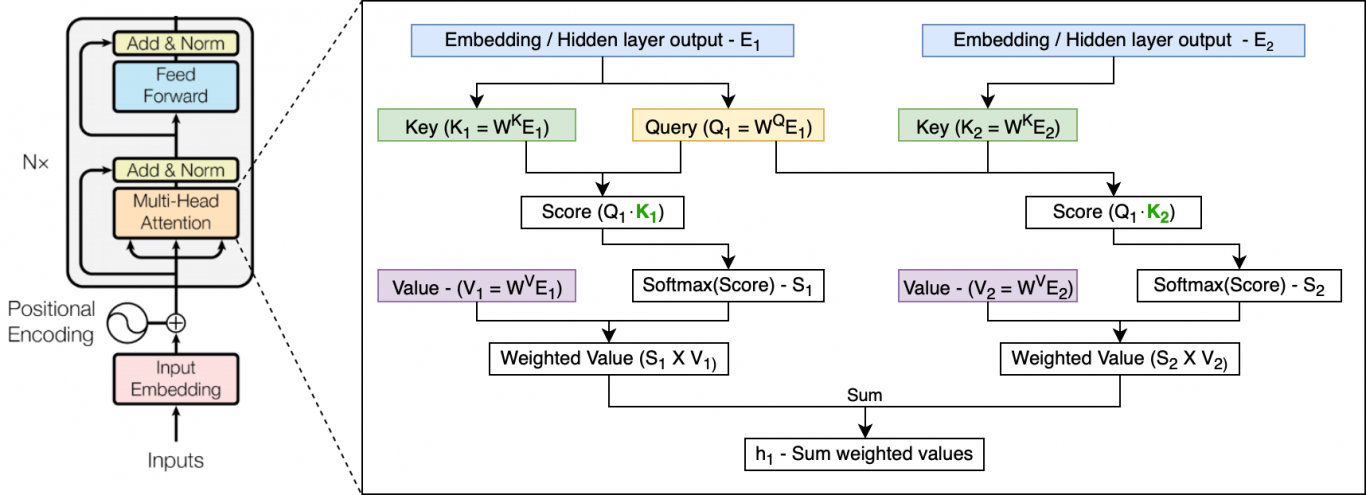

- 循环机制: 不仅添加了当前段的竖向输入,还添加了上个段的当前层输入。两个向量concat一起作为QK,但V不变

- 相对位置编码:暂时不理解